编译/VR陀螺

近日,美国专利商标局正式授予苹果一项与Apple Vision Pro相关的专利,该专利涉及计算机生成的现实环境,包括在计算机生成的现实环境中(如AR)利用多模态输入。虽然录制空间视频最初是通过头显顶部的按钮触发,但苹果的专利还透露,在未来,可通过指定的面部表情触发录制事件,例如体育赛事。

苹果公司在其专利背景中指出,AR技术旨在通过提供一个增强的物理环境来弥补虚拟环境和物理环境之间的差距,该物理环境通过电子信息进行增强。因此,电子信息似乎是用户感知的物理环境的一部分。在一个例子中,AR技术进一步提供了一个用户界面,用于与叠加在增强物理环境中的电子信息进行交互。

在苹果公司的授权专利中,该主题技术的实现至少部分基于电子设备是否与相关基础设备通信耦合来确定电子设备的操作模式。基于确定的操作模式,该主题技术识别一组输入模式,用于启动电子设备视野内内容的录制。

主体技术监控由包括在电子设备中或与电子设备通信耦合的至少一个传感器产生的传感器信息。

此外,当监测到传感器信息指示所识别的一组输入模式中的至少一个已被触发时,主体技术会在电子设备的视野范围内启动内容录制。

苹果头显设备可包括可接收用户输入的硬件元件,例如硬件按钮或开关。由此类传感器和/或硬件元件检测到的用户输入对应于例如从应用内启动共存会话的各种输入模式。

例如,此类输入模式可包括但不限于面部追踪、眼动追踪(例如注视方向)、手部追踪、手势追踪、生物识别读数(例如心率、脉搏、瞳孔放大、呼吸、体温、脑电图、嗅觉)、识别语音或音频(例如特定热词)以及激活按钮或开关等。

图源:patentlyapple

图源:patentlyapple

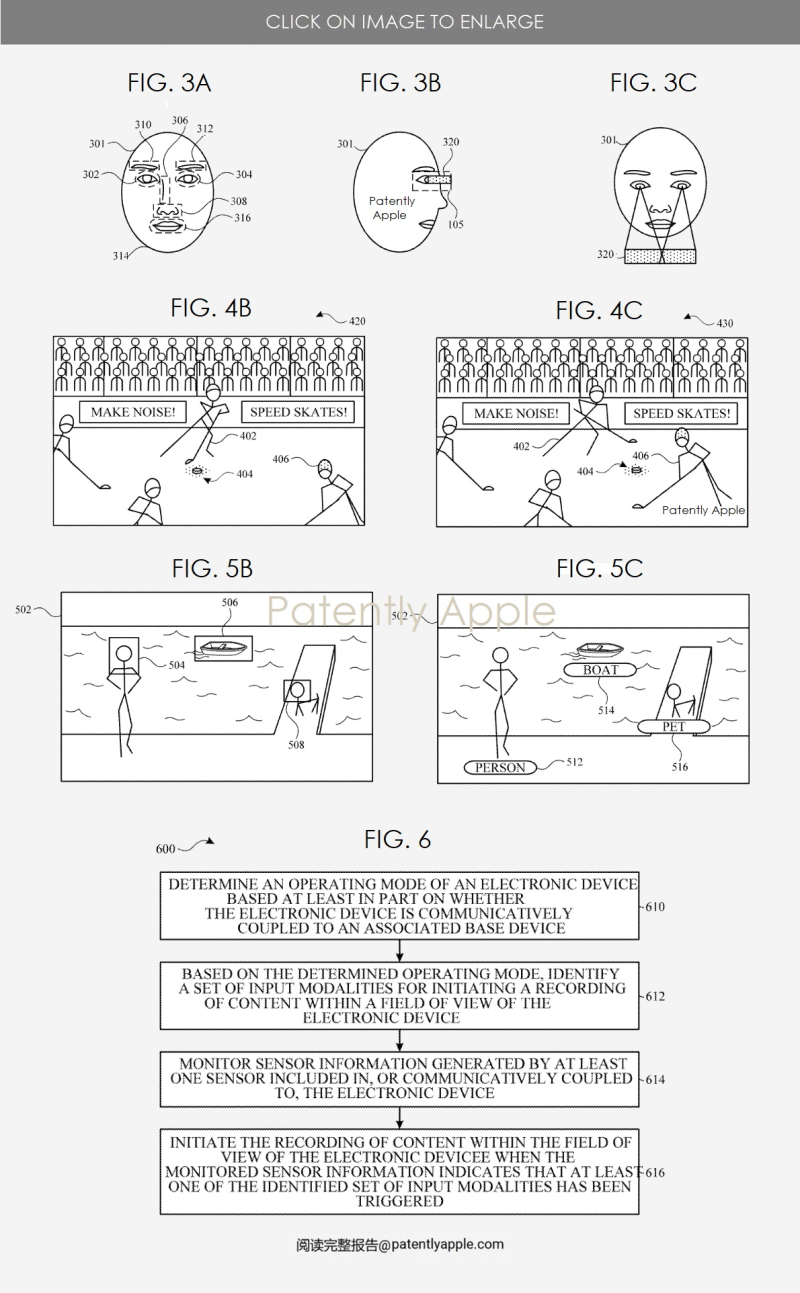

苹果专利图3B和3C说明了根据主题技术的实施方案追踪注视方向以启动计算机生成的现实录制的示例: 图4B和图4C示出了根据主题技术的一些实施例,以确定计算机生成的现实环境中的兴趣区域并基于该区域启动录制的示例;图5B和图5C示出了根据主题技术的一些实施例为计算机生成的现实环境中的各种对象或实体提供注释的示例。

苹果专利图6示出了在苹果头显的视场内启动内容录制的示例过程的流程图。

更具体到苹果专利图3A,苹果指出,在一个实施方案中,电子设备(#105头显)可以利用各种传感器追踪头显用户的面部表情。如图所示,头显的传感器可以追踪用户面部的不同区域。

例如,一个摄像头可追踪用户左眉(#312)和右眉(#310)的移动。另一个摄像头可追踪包括右眼在内的#302区域和包括左眼在内的#304区域的移动。另一个摄像头可以追踪第一区域#308(例如,包括鼻尖和鼻孔)和/或第二区域#306(例如,包括鼻背和/或鼻梁)的运动。同时,另一个摄像头可以追踪用户#301的嘴#316。此外,一个特定的摄像头可以追踪下颌#314,包括用户的下巴。

尽管上文讨论了各种摄像头,但可以理解的是,同一个摄像头可以追踪用户面部的多个部分。例如,同一个摄像头可以追踪用户的下颌和嘴部。

事件检测器可独立分析或组合使用来自不同摄像头的信息。事件检测器可以使用这些信息来检测用户面部的表情。作为对检测到的面部表情的响应,事件检测器可向录制框架发送请求,以启动计算机生成的现实环境中的录制,例如,特定感兴趣区域或视场的录制。

不同类型的面部表情可以对应用户的各种情绪。在一个示例中,头显确定检测到的面部表情对应的特定情绪(例如,惊讶、愤怒、快乐),并根据检测到的表情启动计算机生成的现实环境的录制以响应情绪。

苹果公司的专利图3B和3C示出了根据主题技术的实施方案追踪注视方向以启动计算机生成现实录制的示例。

进一步参见专利图4B,场景#420显示了正在计算机生成现实环境中发生的体育赛事(例如曲棍球比赛)。录制框架继续录制计算机生成的现实环境,并聚焦于感兴趣区域#404,该区域是曲棍球靠近球员#402的曲棍球杆。通过这种方式,感兴趣区域(冰球)可以移动或运动,而录制则移动或追踪感兴趣区域。

想了解更多专利详情,请查阅苹果公司的授权专利11698674。

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 六六(微信 13138755620)

加入行业交流群:六六(微信 13138755620)

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息