文/VR陀螺

过去一年,AI引发的裁员潮已经席卷整个科技行业。从传统互联网公司到游戏厂商,再到软件工程领域的公司,用AI替代人力,或者说让人为AI让路的趋势愈发清晰。尤其是在代码生成能力大幅提升之后,初级开发岗位正成为严重被冲击的对象。

但XR行业似乎暂时处于这场风暴的范围之外。尽管裁员同样存在,但大多与AI没有直接关系,这背后一个重要原因就在于XR内容开发门槛依然过高。想要开发一个XR应用,不仅需要掌握Unity/Unreal等复杂引擎,还要涉及空间计算、3D交互、传感器融合等能力,同时还需要根据设备进行调试,这也使得XR内容的开发成本远高于传统应用。

这也指向XR行业长期存在的一个核心矛盾:内容生产力不足。而AI的真正意义,恰恰在于填补生产力缺口。当谷歌推出Vibe Coding XR,Meta为Immersive Web SDK引入AI Agent工作流时,一个新可能出现了:AI或许并不会直接抢你的饭碗,反而会帮你把饭吃得更快些。

XR生产力困局

XR行业在消费端迟迟未能爆发,除了硬件、价格与佩戴体验等重要因素之外,内容匮乏也是始终绕不开的问题。这其中的原因除了市场影响外,还有一层深层因素,那就是XR内容开发复杂度高,进而导致时间成本与经济成本高昂。

与移动应用或Web应用不同,XR开发具备天然壁垒。除了基础界面开发外,开发者还需要构建三维空间、考虑手势、视线、空间移动等多模态交互,同时还要兼顾物理引擎、碰撞效果、实时渲染等等问题。这意味着开发一个XR应用,往往需要同时具备Unity/Unreal等引擎开发能力、3D美术资源能力、交互设计以及硬件适配等等复合能力。

图源:Meta

这种复杂度也直接拉长了开发周期。传统XR内容开发通常需要数周到数月的时间,期间还需要多轮迭代与测试,并且还需根据设备对内容进行调试。在早期阶段,开发者甚至还得花费大量时间去验证一个基本问题:这个交互在空间中是否好用?这也直接导致创意难以在短时间内落地。

如果说移动互联网的核心是UI设计,那么XR的核心原则就是空间交互设计。但在开发过程中,交互效果无法通过平面预览判断,开发者必须进入设备进行测试,同时还要考虑诸如手势触发是否自然、交互效果是否合理等等问题,这些问题几乎都需要反复佩戴设备进行验证,这就会耗费许多时间成本。

开发的高复杂度和高成本也导致XR内容速度生产慢、团队结构重、开发者门槛高等一系列问题,致使内容供给始终无法形成规模化,也让XR迟迟未能迎来内容爆发的时刻。

也正是在这一背景下,谷歌的Vibe Coding XR与Meta的AI Agent工作流才显得尤为关键:它们并不是在优化开发工具,而是在直接改变XR内容的生产方式。

用自然语言构建XR内容

Vibe Coding这个概念最早由Open AI联合创始人Andrej Karpathy提出,简单来说就是只需要用大白话告诉AI你想要什么样的软件,AI就能为你生成可运行的代码。可以说这种革命性的编程方式打破了高墙,让所有人都能成为开发者。但这阵风迟迟没有吹进XR领域,原因正是XR内容开发门槛高。

谷歌面向开发者推出的Vibe Coding XR组件将打破这一局面,让XR开发者也能借用AI的能力大大提升开发效率。通过这款组件,用户只需用自然语言就能直接生成XR体验。

简单来说,在Vibe Coding XR的开发工作流中,谷歌通过开源XR Blocks框架把XR能力拆解为模块组件让Gemini理解,并结合Gemini的长上下文推理能力、专用系统提示词(system prompt)与精选代码模板自动处理空间逻辑,在60秒内就可以将用户提示词转化为可完全交互、具备物理感知能力的WebXR应用。

图源:谷歌

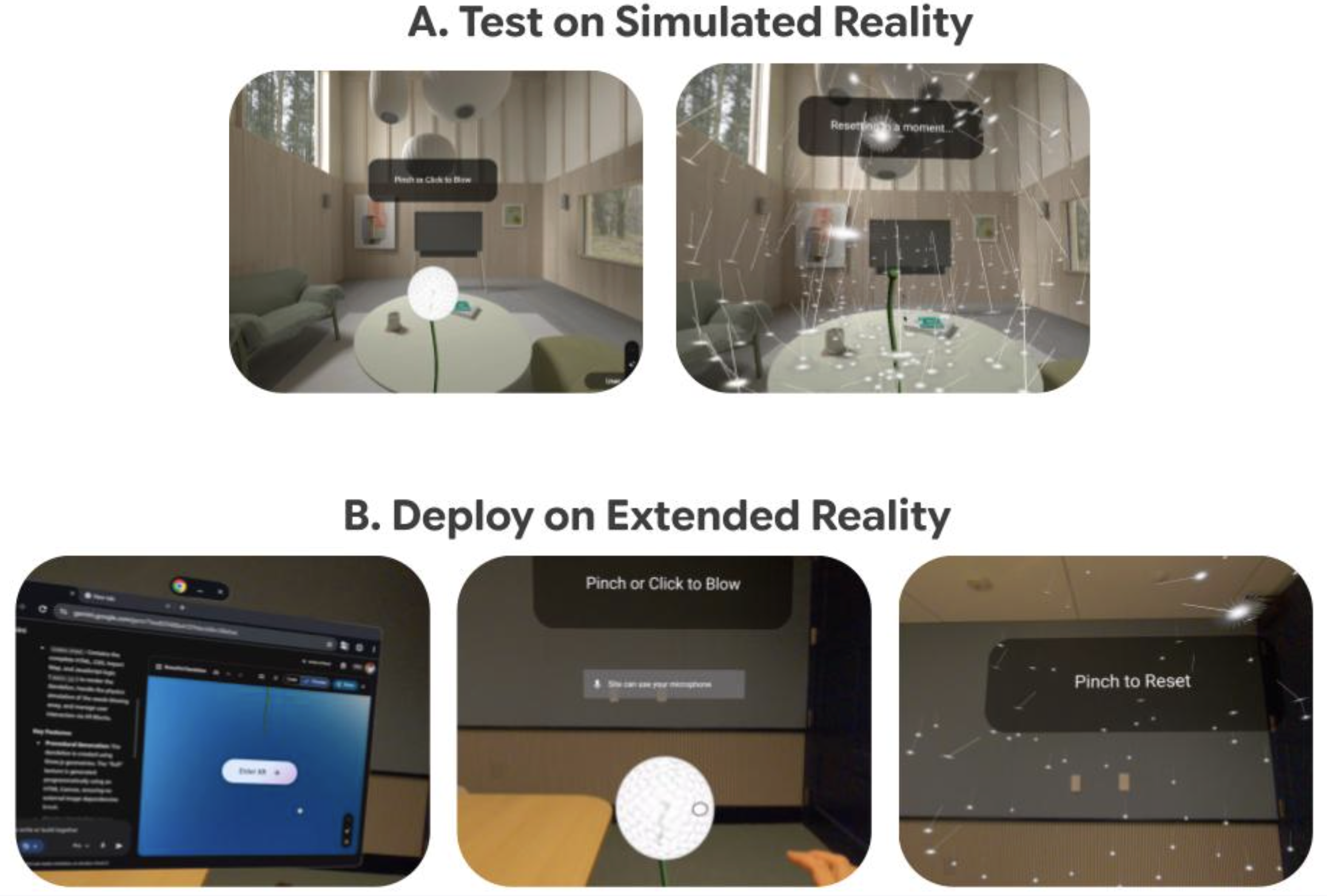

谷歌团队表示,这个组件能够加速AI+XR原型开发,支持用户在电脑端模拟XR环境查看效果,并且可以快速在Android XR头显中体验由AI生成的原型。

整个开发过程可以压缩为4步:

1、意图输入(Prompt)

无需任何XR专业知识或编程技能,用户可直接用自然语言描述想要开发的体验,如“创建一朵可以吹散的蒲公英”。

2、由Gemini设计并实现XR交互体验

Gemini会从XR Blocks示例中进行学习,完成场景配置、感知模块与交互逻辑搭建,最终生成可交互的XR应用。

3、实时演示

生成后的XR应用可在Android XR环境中查看。用户可通过捏合手势点击 “进入XR” 按钮,即可立即看到效果:一株动态蒲公英会在捏合交互下随风飘散。用户还可进一步点击 “分享” 按钮,为自己的应用生成可公开分享的链接。

4、快速迭代

为简化测试流程,谷歌还在桌面端Chrome浏览器中提供了 “模拟现实” 环境。创作者可先快速制作原型并测试交互效果,再部署到Android XR设备上运行。深度感知、手部交互、物理模拟等诸多高级感知功能在Android XR设备上能获得最佳体验。

而与谷歌强调的生成能力不同,Meta在其开源框架Immersive Web SDK(以下简称IWSDK)中引入的AI Agent更像一个自动化开发系统。Meta表示,IWSDK可与常用的AI编程助手兼容,包括 Claude Code、Cursor、GitHub Copilot、Codex等工具。借助这些工具,开发者可以通过完整智能体闭环打造高品质VR体验。

在官方定义中,这一能力的核心不是代码生成,而是让AI具备“观察-执行-反馈-修复”的完整开发循环能力。具体来说,Meta给出的流程是一个具备环境感知能力的智能体循环。

与Vibe Coding XR类似,开发者也可以通过自然语言输入需求,AI则会基于IWSDK自动编写代码、加载场景、测试交互、排查并修复漏洞,全程无需开发者动手。开发者也可以开启协作模式,在同一个浏览器标签页中与AI共同开发。

在完成初步的构建后,开发者还可用自然语言进行优化,AI会自动调整参数、向开发者确认修改并保存。同样,这个自动化开发系统也具备一键分享功能,并可部署到任意托管平台(GitHub Pages、Vercel、Netlify等),任何人都能通过VR打开体验。

如果说过去的XR开发是人写代码、机器执行,那么Meta正在推动的模式则是让机器写代码、运行代码、修复代码,人只负责定义目标。有了这个工作流,人的身份也从执行者进一步转变为监督者。

XR开发者将如何被重构?

谷歌Vibe Coding XR与Meta IWSDK AI Agent工作流的推出指向了同一个结果,那就是XR开发正在从单纯的编程行为转变成表达行为。

在未来,开发者的写代码能力将被边缘化,更重要的能力将是体验设计能力、空间交互理解与Prompt表达能力。而XR内容生产者也将从少数专业开发者扩展到诸如产品经理、设计师、内容创造者甚至普通用户,随着创意基数扩大,未来或将会催生出更多全新内容形态与玩法。

在AI加持下,XR内容的生产速度将显著上升,同时开发成本也能进一步下降。这其中的意义是,XR行业将具备迎接内容爆发的基础。

至于许多人关心的AI是否也会替代XR从业者的问题,短期内不会大规模发生,但趋势也很明确:初级开发岗位或将被压缩,同时创意设计、AI协作等等新岗位也将持续涌现。

写在最后

在过去,XR行业的核心变量始终离不开硬件的形态、性能、价格等要素。但在AI的加持下,XR行业的关键变量或许将逐步从硬件转向生产力。当Vibe Coding XR让“想法即应用”,IWSDK AI Agent让开发过程自动化,XR行业也将迎来最关键的一块拼图:内容生产能力。

当内容可以被无限生成,XR是否会迎来属于它的内容爆发时刻?

投稿/爆料:tougao@youxituoluo.com

稿件/商务合作: 林南(微信 19250561593) 六六(微信 13138755620)

加入行业交流群:林南(微信 19250561593)

版权申明:本文为VR陀螺原创,任何第三方未经授权不得转载。如需转载请联系微信:vrtuoluo233 申请授权,并在转载时保留转载来源、作者以及原文链接信息,不得擅自更改内容,违规转载法律必究。文中有图片、视频素材来自互联网或无法核实出处,如涉及版权问题,请联系本网站协商处理。

元宇宙数字产业服务平台

下载「陀螺科技」APP,获取前沿深度元宇宙讯息